�P�ڈD��̎����Python��ȌW���Ľ̳̣���һ����

��B

���@ƪ�����У��҂����W����Έ�(zh��)�ЈD��̎��������ƪ�����У��҂�ʹ�õ��Ď���Scikit Image��

���A֪�R

1��ʲô�LjD��

�D��(sh��)��(j��)�������ı�֮���Ҋ�Ĕ�(sh��)��(j��)����ô����X����������ڰ��Ơ��F��ǰ�������أ�

��ʹ��һ���Q�����ص�С�����ξW�����ظ��wһ��С�^(q��)�����б�ʾ�ɫ��ֵ���D���е�����Խ�࣬���|��Խ�ߣ��惦����ăȴ�Խ�ࡣ

�����@�ӡ��D��̎����Ҫ��̎���@Щ�Ϊ������أ��Еr�����ؽM�����Ա�Ӌ��Cҕ�X�㷨���ԏ�����ȡ������Ϣ��

2��NumPy��Skimage�ĈD����A

��Matplotlib��Skimage���D������NumPy ndarray���d��

from skimage��io import imread �� pip install scikit��image

image �� imread����images��colorful��scenery��jpg����

������ type��image��

numpy��ndarray

NumPy��(sh��)�M�����`���ԡ��ٶȺ��������D��̎��Ҳ�����⡣

Ndarrays�����p�əz���D���һ��Ԕ����Ϣ������D��ijߴ磺

������ image��shape

��853�� 1280�� 3��

������ image��ndim

3

�� The number of pixels

������ image��size �� 853 �� 1280 �� 3

3275520

�҂��ĈD��߶Ȟ�853���أ����Ȟ�1280���ء������S��ʾRGB���t���G���{���ɫͨ����ֵ���Ҋ�ĈD���ʽ��3D��

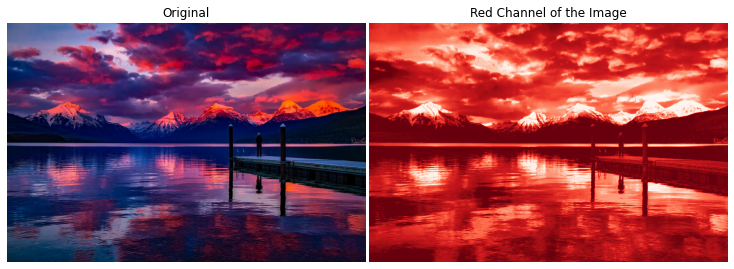

�����ͨ�^��Ҏ(gu��)NumPy�����z��������ֵ�����棬�҂��Lԇ�����D���ԙz�������ɫͨ���е�ÿһ��ͨ����

red �� image�ۣ��� ���� 0��

compare��image�� red�� ��Red Channel of the Image���� cmap��type����Reds��r����

green �� image�ۣ��� ���� 1��

compare��image�� green�� ��Green Channel of the Image���� ��Greens��r����

blue �� image�ۣ��� ���� 2��

compare��image�� blue�� ��Blue Channel of the Image���� ��Blues��r����

0��ʾ�tɫ��1��ʾ�Gɫ��2��ʾ�{ɫͨ�����dz����Ρ�

��(chu��ng)���˃ɂ�����(sh��)��show��compare�������@ʾһ���D������@ʾ���Ѓɂ��M�б��^���������̳��У��҂����V��ʹ���@�ɂ�����(sh��)��

���ռs����ndarray�ĵ����S�����ɫͨ����������������ѭ�˼s����Skimageͨ���ṩ����(sh��)��ָ���@�N�О顣

�D���cͨ����Matplotlib�L�D��ͬ��������ԭ�c��λ�����½ǣ�����λ�����Ͻǵ�λ�ã�0��0����

������ show��image�� axis��True��

���҂���Matplotlib���L�ƈD��r���S��ʾ���ص�����҂�ͨ�����[��������

3����Ҋ�D�Q

�҂���Ҫ��(zh��)�е��Ҋ�ĈD���D�Q�nj���ɫ�D���D�Q��Ҷȡ��S���D��̎���㷨��Ҫ�ҶȈD������ɫ���LjDƬ�Ķ��x�������]������Ӌ��C��Ȼ������ȡ������Ϣ��

from skimage��color import rgb2gray

image �� imread����images��grayscale��example��jpg����

�� Convert image to grayscale

gray �� rgb2gray��image��

compare��image�� gray�� ��Grayscale Image����

������ gray��shape

��853�� 1280��

�����D���D�Q��Ҷȕr���������Gʧ������S�ȣ��ɫͨ�����෴���D��(sh��)�M�е�ÿ����Ԫ��F(xi��n)�ڱ�ʾuint8��͵�����(sh��)�������ķ�����0��255���ṩ256�N�Ҷȡ�

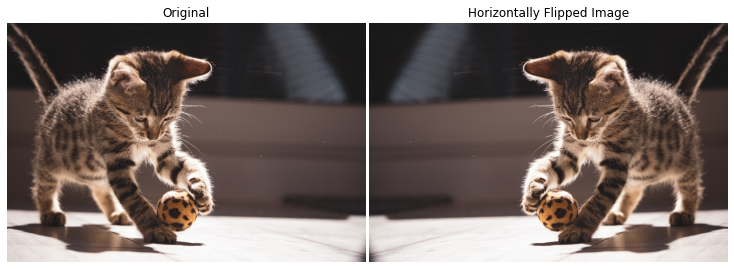

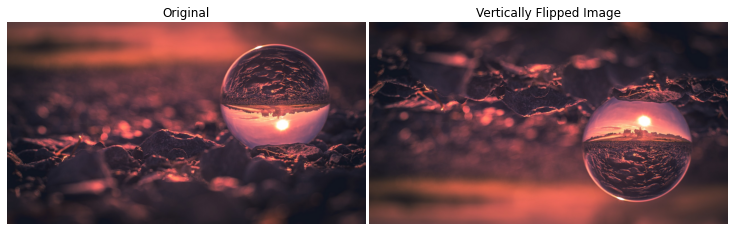

��߀����ʹ��np��flipud����np��fliplr֮�NumPy����(sh��)���S�����������κη�ʽ�ٿv�D��

kitten �� imread����images��horizontal��flip��jpg����

horizontal��flipped �� np��fliplr��kitten��

compare��kitten�� horizontal��flipped�� ��Horizontally Flipped Image����

ball �� imread����images��upside��down��jpg����

vertically��flipped �� np��flipud��ball��

compare��ball�� vertically��flipped�� ��Vertically Flipped Image����

�ڡ��ɫ��ģ�K�У�������ҵ��S������׃�Q����(sh��)��̎��D���е��ɫ��

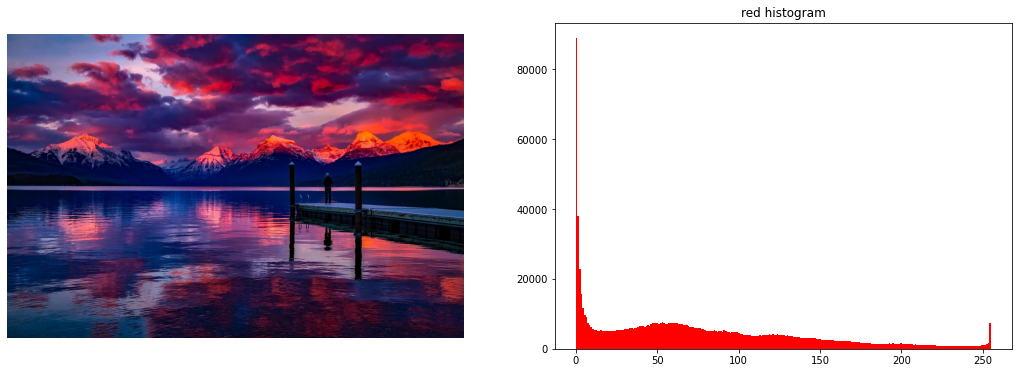

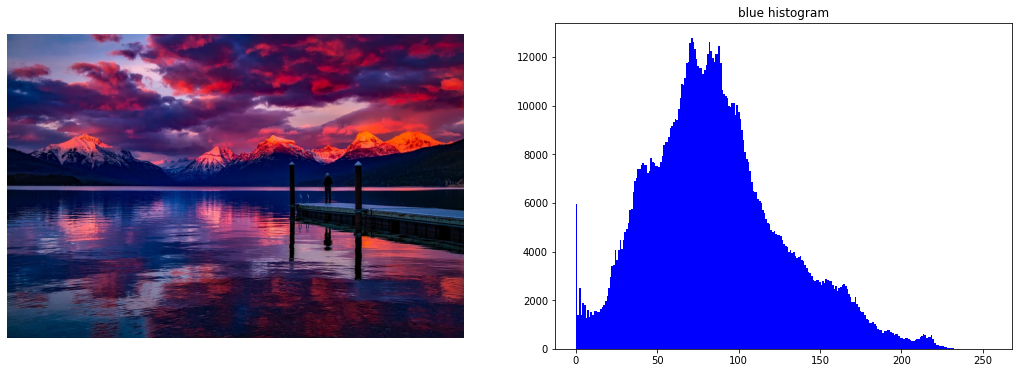

4���ɫͨ��ֱ���D

�Еr���鿴ÿ���ɫͨ���ď����������˽��ɫ�ֲ����҂�����ͨ�^��Ƭÿ���ɫͨ�����L��������ֱ���D�팍�F(xi��n)�@һ�c�������Lj�(zh��)�д˲����ĺ���(sh��)��

def plot��with��hist��channel��image�� channel����

channels �� �ۣ�red���� ��green���� ��blue����

channel��idx �� channels��index��channel��

color �� channels��channel��idx��

extracted��channel �� image�ۣ��� ���� channel��idx��

fig�� ��ax1�� ax2�� �� plt��subplots��

ncols��2�� figsize����18�� 6��

��

ax1��imshow��image��

ax1��axis����off����

ax2��hist��extracted��channel��ravel������ bins��256�� color��color��

ax2��set��title��f����channels��channel��idx�ݣ� histogram����

����Matplotlib��һЩ����(ji��)֮�⣬��߀��ԓע��hist����(sh��)���{�á���ȡ�ɫͨ�����䔵(sh��)�M���҂�����չƽ��1D��(sh��)�M����������f�ohist����(sh��)��

bin��(sh��)����ԓ��256����ÿ������ֵ����һ����0��ʾ��ɫ��255��ʾ��ȫ��ɫ��

�҂�ʹ�ò�ɫ�L���D��

colorful��scenery �� imread����images��colorful��scenery��jpg����

plot��with��hist��channel��colorful��scenery�� ��red����

������ plot��with��hist��channel��colorful��scenery�� ��green����

������ plot��with��hist��channel��colorful��scenery�� ��blue����

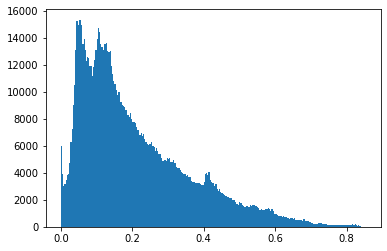

߀����ʹ��ֱ���D�ڌ��D���D�Q��ҶȺ��ҳ��D���е����ȣ�

gray��color��scenery �� rgb2gray��colorful��scenery��

plt��hist��gray��color��scenery��ravel������ bins��256����

�����(sh��)���ص�ֵ�^�ͣ���龰��D���^����

�҂��������²���̽ӑֱ���D�ĸ������á�

�^�V��

1���ք��ֵ

�F(xi��n)�ڣ��҂���������Ȥ�Ė|�������^�V�D���҂����W���ĵ�һ���������ֵ�����҂����dһ��ʾ���D��

stag �� imread����images��binary��example��jpg����

������ show��stag��

�ֵ�ָ��ڈD��ָĿ�˙z�y��߅����݆����ȡ�ȷ��������V���đ��ã�����Ҫ���څ^(q��)�ֈD��ı�����ǰ����

�ֵ̎���ڸߌ��ȶȻҶȈD����Ч����ã�

�� Convert to graysacle

stag��gray �� rgb2gray��stag��

������ show��stag��gray��

�҂����Ļ������ք��ֵ�O���_ʼ��Ȼ���D���Ԅ��ֵ�O�á�

���ȣ��҂��鿴�ҶȈD�����������ص�ƽ��ֵ��

������ stag��gray��mean����

0��20056262759859955

Ոע�⣬ͨ�^�����лҶȈD���ֵ����256�������ҶȈD���������0��1֮�g�wһ����

�҂��õ���ƽ��ֵ��0��2���@���҂��ṩ�˿���Ҫʹ�õ��ֵ�ij����뷨��

�F(xi��n)�ڣ��҂�ʹ���@���ֵ���M���ڴa�������������ֵ�����ֵ����t��ֵ��׃?y��u)?����ɫ��1����ɫ���Q��Ԓ�f���҂��õ�һ���ڰ�ֵ�D��

�� Set threshold

threshold �� 0��35

�� Binarize

binary��image �� stag��gray �� threshold

compare��stag�� binary��image�� ��Binary image����

���@���汾�У��҂����Ը�����^(q��)��¹��݆�����҂����Է��D���֣�ʹ����׃?y��u)��ɫ�?/p>

inverted��binary �� stag��gray ���� threshold

������ compare��stag�� inverted��binary�� ��Binary image inverted����

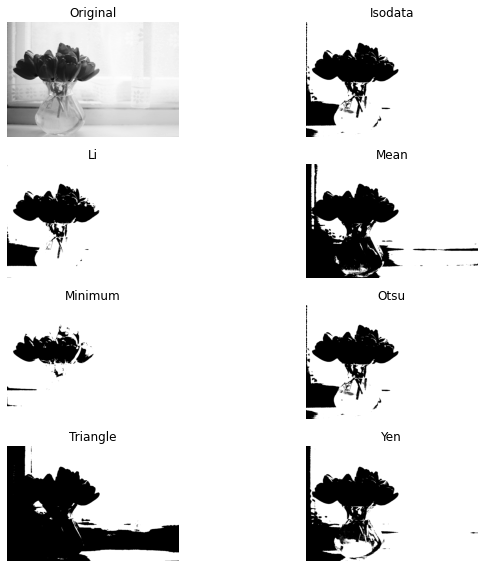

2���ֵ��ȫ��

�mȻ�Lԇ��ͬ���ֵ���^���������D���Ӱ푿��ܺ���Ȥ�����҂�ͨ��ʹ�ñ��҂��������Ӌ����(w��n)�����㷨���(zh��)���ֵ�ָ

�кܶ��ֵ�㷨�����Կ��ܺ��y�x��һ�N�����@�N��r�£�skimage����try��all��threshold����(sh��)��ԓ����(sh��)�ڽo���ĻҶȈD�����\���߷N�ֵ�㷨���҂����dһ��ʾ�����M���D�Q��

flower �� imread����images��global��threshold��ex��jpg����

flower��gray �� rgb2gray��flower��

compare��flower�� flower��gray��

�҂��������Ƿ����ʹ���ֵ��(y��u)���������������

from skimage��filters import try��all��threshold

fig�� ax �� try��all��threshold��

flower��gray�� figsize����10�� 8���� verbose��False

��

�������������ģ�һЩ�㷨���@���D���Ϲ����ø��ã��������㷨�t����⡣otsu�㷨���������ã������҂����^�m(x��)ʹ������

���@һ�c�ϣ�������Ո��ע���������ԭʼ�D��

������ show��flower��

�D�������������̫��⾀�ĺ���Ĵ������M�����҂�����ͨ�^�L�ƻ�ɫ�������ֱ���D���C���@һ�c��

������ plt��hist��flower��gray��ravel������ bins��256����

�����A�ڵ��ǘӣ������(sh��)���ص�ֵ��λ��ֱ���D���h�ˣ��@�C���������ֶ��������ġ�

��ʲô�@����Ҫ������(j��)�D������ȣ��ֵ�㷨������Ҳ���l(f��)��׃������ˣ��ֵ�㷨ͨ���ЃɷN��ͣ�

ȫ�֣��m���ھ��о��y(t��ng)һ��������Ƭ

�ֲ������ڲ�ͬ�DƬ�^(q��)���о��в�ͬ���ȼ��e�ĈD��

������D����ڵڶ������҂Ȳ��ֱ���һ�����ö࣬ʹ�䱳���������҂�����������ʹ��ȫ���ֵ�㷨���@���Ǟ�ʲôtry��all��threshold�������㷨�����ܶ��ܲ��ԭ��

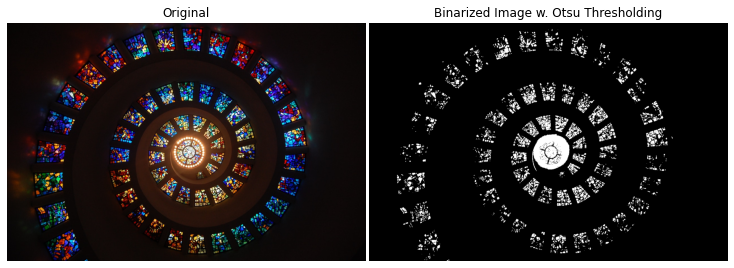

�Ժ��҂����ص�������ʾ���;ֲ��ֵ���F(xi��n)�ڣ��҂������d��һ�����ȸ����_�Č��������Lԇ�Ԅ��O���ֵ��

spiral �� imread����images��otsu��example��jpg����

spiral��gray �� rgb2gray��spiral��

compare��spiral�� spiral��gray��

�҂�����Skimage��ʹ��ͨ�õ�ȫ���ֵ�㷨threshold��otsu��

from skimage��filters import threshold��otsu

�� Find optimal threshold with ��threshold��otsu��

threshold �� threshold��otsu��spiral��gray��

�� Binarize

binary��spiral �� spiral��gray �� threshold

compare��spiral�� binary��spiral�� ��Binarized Image w�� Otsu Thresholding����

�������ø��ã�

3���ֵ���ֲ�

�F(xi��n)�ڣ��҂���ʹ�þֲ��ֵ�㷨��

�ֲ��㷨���Pע�����D�����Pע���������Խ�ጲ�ͬ�^(q��)������Ȳ�����skimage�г�Ҋ�ľֲ��㷨��threshold��local����(sh��)��

from skimage��filters import threshold��local

local��thresh �� threshold��local��flower��gray�� block��size��3�� offset��0��0002��

binary��flower �� flower��gray �� local��thresh

compare��flower�� binary��flower�� ��Tresholded flower image����

����ʹ��offset����(sh��)���ҵ���������Ҫ����шD��offset�Ǐľֲ����������ƽ��ֵ�Мpȥ�ij���(sh��)��ԓ������������local��threshold�е�block��size����(sh��)�_����ԓ����(sh��)��ʾ�㷨��ÿ�������χ��@ÿ���c�鿴�����ؔ�(sh��)��

�@Ȼ��ͬ�r�{��offset��block��size��һ��ȱ�c�����ֲ��ֵ��Ψһ���քӻ�ȫ���ֵ�a�����ýY�����x헡�

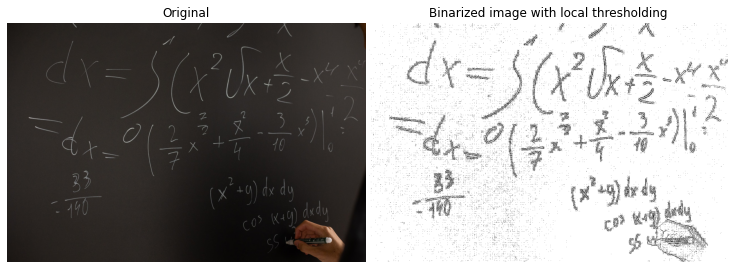

�҂����eһ�����ӣ�

from skimage��filters import threshold��local

handwriting �� imread����images��chalk��writing��jpg����

handwriting��gray �� rgb2gray��handwriting��

�� Find optimal threshold using local

local��thresh �� threshold��local��handwriting��gray�� offset��0��0003��

�� Binarize

binary��handwriting �� handwriting��gray �� local��thresh

compare��handwriting�� binary��handwriting��

��Binarized image with local thresholding����

�������������ģ����^�ֵ̎���ڰ��ϵĹP�E���Ӿ�����

4��߅���z�y

߅���z�y�ںܶ�涼�����ã������R�e��������ȡ�����������M��Ӌ��(sh��)�ȵȡ�

�҂����Ļ�����Sobel�V�����_ʼ�����ڻҶȈD���в��Ҍ����߅�����҂������dһ��Ӳ�ňDƬ��������ʹ��Sobel�V������

from skimage��filters import sobel

coins �� imread����images��coins��2��jpg����

coins��gray �� rgb2gray��coins��

coins��edge �� sobel��coins��gray��

compare��coins�� coins��edge�� ��Images of coins with edges detected����

sobel��ֱ���ˮ�����ֻ���ڻ�ɫ�D�����{�������ɫ@������������ݔ�����҂����ں���IJ����п���Sobel�ĸ����s�汾��

5��ƽ��

��һ�N�D���^�V���g��ƽ�����S����������uһ�ӵĈD����ܰ����S�C��������ML��DL�㷨�]���κ��Ѓrֵ����Ϣ��

���磬�u�܇���ë�l(f��)���o�D�����������@���ܕ�ʹMLģ�͵�ע����ƫ�x��Ҫ�����������@�N��r�£��҂�ʹ��ƽ����ģ������߅�������͌��ȶȡ�

chickens �� imread����images��chickens��jpg����

������ show��chickens��

��˹ƽ���������к�����ƽ�����g֮һ��

from skimage��filters import gaussian

smoothed �� gaussian��chickens�� multichannel��True�� sigma��2��

compare��chickens�� smoothed�� ��An image smoothed with Gaussian smoothing����

�����ͨ�^�{��sigma����(sh��)������ģ����Ч�������������̎��RGB�D��Ո��Ҫ��ӛ��multichannel�O�Þ�True��

����D��ֱ���̫�ߣ�ƽ��Ч���������ۿ�����������Ȼ��Ч��

ԭ�Ę��} : �P�ڈD��̎����Python��ȌW���Ľ̳̣���һ����

����

����

�l(f��)���uՓ

Ոݔ���uՓ����...

Ոݔ���uՓ/�uՓ�L��6~500����

�DƬ��

-

OpenAI�l(f��)����AI�g�[�����Ј���η������ң�

-

�R���ط�һ������(zh��n)�������؆���(chu��ng)ʼ��ģʽ

-

�C���ˊW�\����(zh��n)�����C����ժ�����칤Ultra������λ�������w�ˡ�

-

�惦Ȧ���ܣ����������V�۾S�����r121�f

-

�L����܇ĸ��˾ͻȻ�������ġ��Ї��L�����������¿Ƽ���

-

����ǰؓ؟�ˆ�ľ��܉BP���m(x��)�������o��

-

�ֹ�(ji��)AI Labؓ؟���ж�κ�Ƹ��Seed�M���{����

-

�T���ֹɱ��ף��V�������o���ؑ�

���»������

-

11��7���������u>> ���u�x���S�Ʊ���OFweek 2025����ʮ�ã���(li��n)�W�ИI(y��)����u�x

-

11��20����������>> �����M���d��RISC-VоƬ�l(f��)չ�F(xi��n)���c�yԇ����(zh��n)-��Ƥ��

-

����-11.25�������d>>> �M˹�а�Ƥ�������ԣ���܇���aδ�����P�I��

-

11��27����������>> �����̎�ϵ�С���܇��Ӽ��g�ھ����

-

11��28���������d>> ����Ƥ�������ʶ��� �o���ƿء���283FC�����ԙz�f�ñ�

-

12��18����������>> �������h��OFweek 2025����ʮ�ã���(li��n)�W�a�I(y��)���

���]���}

- 1 ��˹�����˱����ϙC���˴���������r3.6�|

- 2 AI �r�����������뮔������ �����l�ǡ��O������

- 3 ���c�������R���I�ܹ��ء���˹�D���~��һ���r�_�����x��Ť̝��ӯ

- 4 L3�Ԅ��{����ڣ��Ƴ�܇���g������̭

- 5 �[��4���һ�Q���`�F(xi��n)������(li��n)�W���������w����

- 6 �C����9�´��¼���3�҇��a�C���˛_��IPO���ИI(y��)�����c���Y�ل�(chu��ng)�¸ߣ�

- 7 �ȸ衰�㽶��������ʾ�����a���AI��Σ�C߀���D�C��

- 8 7���C���˴�ţ�ɣ��߹ܹɖ|�F(xi��n)VS�C�����ͱ��F��ԓ���l��

- 9 �˲��T(li��n)�ַ���L3�Ԅ��{���^�_ʼƴ���f�|�Ј���

- 10 OpenAI�l(f��)����AI�g�[�����Ј���η������ң�